OpenAI сняла запрет на использование ChatGPT в военных целях

Компания OpenAI без огласки удалила маркировку из своей политики использования, запрещающую использовать чат-бота ChatGPT в «военных целях». Об этом сообщает The Intercept.

До 10 января «Политика использования» включала запрет на «деятельность, сопряженную с высоким риском физического вреда, включая разработку оружия и военные действия». Новые положения сохраняют запрет на использование услуг для «нанесения вреда себе или другим» и приводят в качестве примера «разработку оружия», но полный запрет на «военное» применение исчез.

По словам OpenAI, изменения призваны сделать документ «более понятным и читабельным». «Такой принцип, как “не причиняй вреда другим”, является широким, но легко понятным и актуальным во многих контекстах.

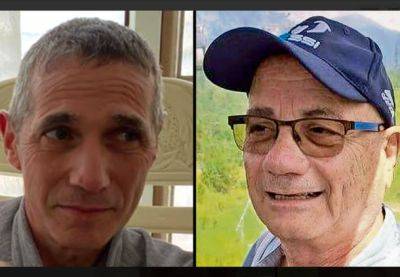

Кроме того, в качестве ярких примеров мы специально привели оружие и ранения других людей», — заявил представитель компании. Однако в фирме так и не объяснили, почему пропала связанная с военными формулировка. Управляющий директор AI Now Майерс Уэст допустил, что искусственный интеллект использовался для атак Израиля по Сектору Газа.

По его мнению, именно поэтому OpenAI удалила запрет на военное применение технологий. Напомним, в феврале 2023 года

. forklog.com

forklog.com